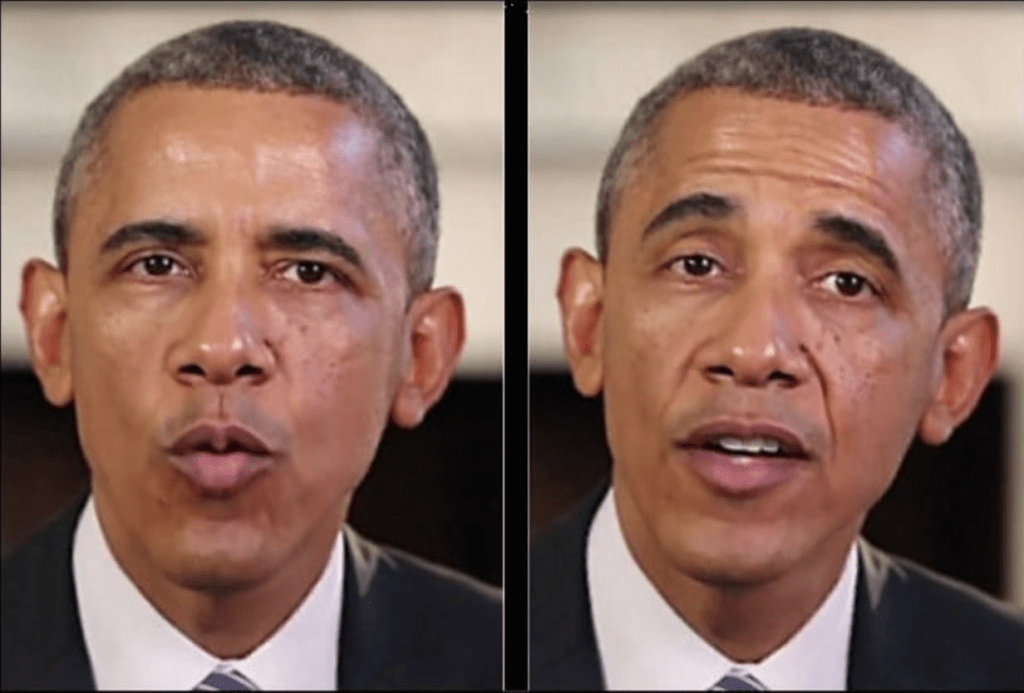

İngilizce deep learning (derin öğrenme) ve fake (sahte) kelimelerinin birleşiminden oluşan deepfake terimi kısaca, herhangi birinin yüzünü dijital olarak başka birinin vücuduna monte ederek, elde edilen görüntünün istenilen şekilde kullanılmasına olanak sağlayan bir işlem. . İnternetten kolayca ulaşılabilen algoritmalar sayesinde A kişisinin yüzü B kişisine montajlanabiliyor.

Deepfake sadece görüntüleri kopyalamıyor aynı zamanda bir kişinin sesini de bir başkasına montajlayabiliyor. Bunlara da audio deepfake ya da sesli deepfake deniyor. Bu teknolojinin çıkış noktası insan yaşamını iyileştirmeye yönelik çeşitli uygulamalar geliştirmekti. Örneğin, sesli kitap üretmek ya da tıbbi sorunlar nedeniyle sesini kaybeden insanların iletişim kurmasına yardımcı olmak amaçlanıyordu.

Fotoğraf: https://gulfbusiness.com/deepfakes-novel-trend-or-novel-threat/

Benzer bir şeklide deepfake teknolojisi sinema ve televizyon sektöründe sıklıkla kullanılıyor. Örneğin sesi kısılan ya da sesini kaybeden oyuncular için dijital ses oluşturmak veya oyuncular repliklerini şaşırırsa sahneyi yeniden çekmeye gerek kalmadan bu teknolojiyi kullanarak düzeltmek mümkün olabiliyor.

Ancak deepfake son dönemlerde son derece riskli kullanım alanlarında sahne almaya başladı. Deepfake siber zorbalık, hakaret ve şantaj gibi alanlarda insanları tehdit eden boyutlara erişti. 2017 yılında oyuncuların ve ünlülerin yüzleriyle deepfake teknolojisi birleştirilerek “ünlü pornografisi” büyük bir trend haline geldi. Ancak deepfake, ünlülerle sınırlı kalmayınca insanlık için ciddi bir tehlike oluşturmaya başladı.

Peki Deepfake insanlar için gerçekten bir tehlike mi?

Harvard Kennedy School’da yayımlanan analizdeki veriler, yapay zekanın yanlış bilgi yaratmayı kolaylaştırabileceğini ve böylece yanlış bilgi arzını artırabileceğini ancak bunun insanların kesinlikle daha fazla yanlış bilgi tüketeceği anlamına gelmediğini söylüyor. Araştırmacılara göre yanlış bilgi tüketimi çoğunlukla arz ile değil talep ile sınırlı.

Analizin vurguladığı bir diğer nokta ise yeni teknolojilerin insanlarda her zaman panik havası yarattığı gerçeği. Yanlış bilgi sorununu artıran ve bu konuda teyitçileri zorlayan şey tek başına yapay zekanın ürettiği görseller ve deepfakeler değil. Bağlamından koparılmış sözler, manipüle edilmiş görseller ve çarpıtılmış içerikler teyitçiler için daha büyük bir sorun.

Fotoğraf: https://www.timeforkids.com/g56/fakeout-2/

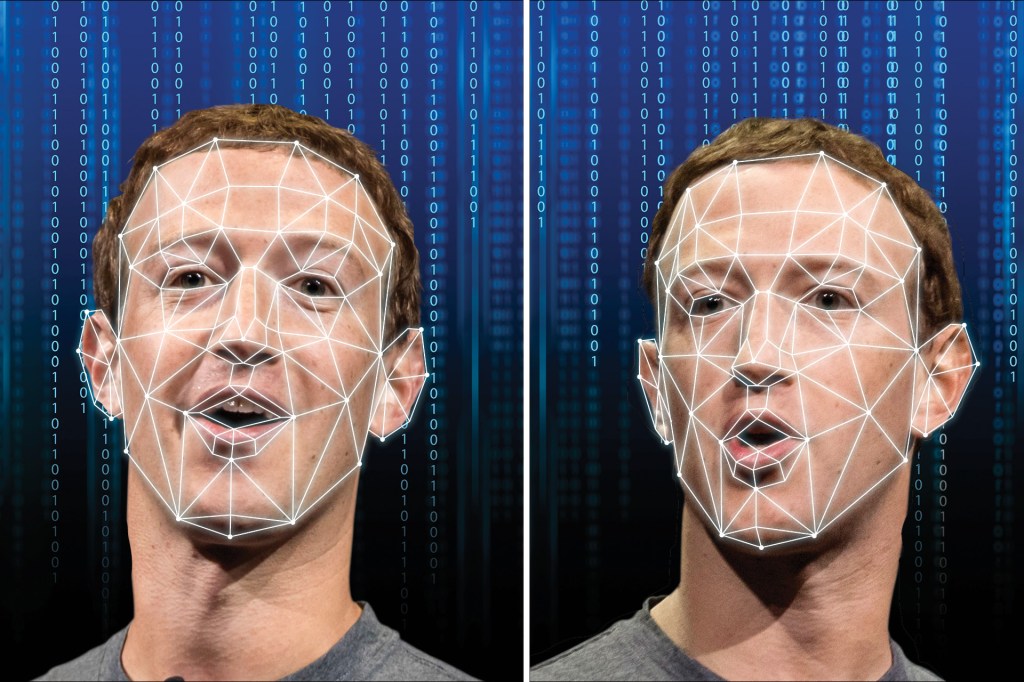

Yapılan araştırmanın aksini gösteren bulgular da var. Deepfake sadece ünlü kesimi değil aynı zamanda siyasetçileri de tehdit eden bir teknoloji. Örnek olarak Ocak 2024’te ABD’de aday adaylarının yarıştığı ön seçimlerde ABD Başkanı Joe Biden’ın sahte ses kaydı New Hampshire’daki seçmenler arasında dolaşıma girmişti. Otomatik çağrılar yoluyla seçmenlere dinletilen kayıtta Biden’ın seçmenlere yönelik “Ön seçimlerde oy kullanmamaları ve oylarını Kasım ayındaki Başkanlık Seçimi’ne saklamalarını” öğütlediği duyuluyordu.

Bloomberg’in haberine göre bu olaydan günler sonra, yazılı komutlardan ses kayıtları üreten yapay zeka girişimi ElevenLabs, sahte Biden sesinin yaratıcısının işine son verildi.

Araştırmalara göre savaş zamanlarında siyasi amaçlı hazırlanan deepfake videoları, sosyal medya kullanıcılarının gerçeklik algısını bulandırıyor.

Bununla beraber geçtiğimiz günlerde Londra’da yapay zekanın karanlık yüzünün çocuklara kadar indiğini gösteren gelişmeler yaşandı. St. Thomas Aquinas isimli Katolik okulda öğrenciler, arkadaşlarının yapay zeka ile oluşturulmuş deepfake çıplak fotoğraflarını paylaştı.

CBC’nin aktardığına göre fotoğraflar sosyal medyadan alınıp yapay zeka ile değiştirilmiş. Londra’daki yaşanan bu olay tek bir örnek olsa da deepfake’in benzer durumlara neden olabileceğinin açık bir göstergesi.

Deepfake Ne Değildir?

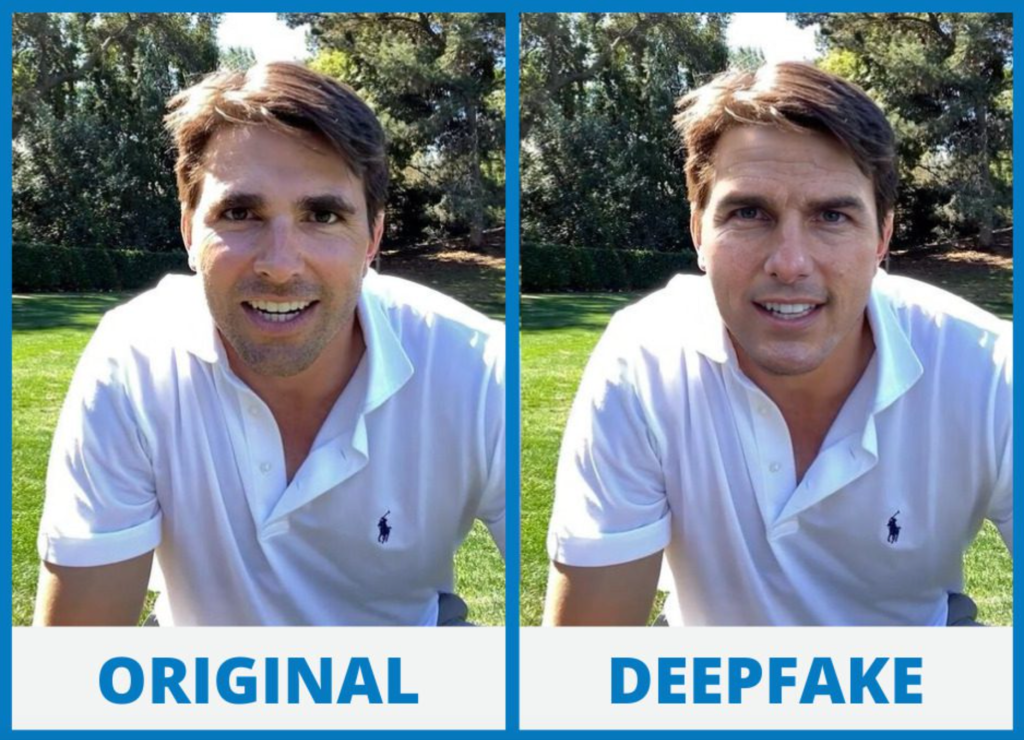

Deepfake videoları sosyal medyada yer alan cheapfake içerikleriyle karıştırılmamalı. Cheapfake görseller, maskeleme tekniği ile hazırlanmış basit içeriklerdir. Bu tip videoların sahte olduğunu anlamak için görüntülere uzun uzun odaklanmak gerekmez. Kişi bu videoları herhangi bir uzmanlık gerekmeksizin ilk bakışta kolayca ayırt edebilir. Cheapfake içerikleri genellikle sosyal medya üreticileri tarafından eğlence amaçlı yapılmaktadır.

Deepfake, gerçekçi sahte görüntüler ve videolar oluşturmak için kullanılan bir teknolojidir. Dezenformasyon yaymak, itibar zedelemek ve kimlik hırsızlığı gibi birçok tehlikeyi beraberinde getirebilir.

Kaynaklar:

https://dergipark.org.tr/tr/download/article-file/1235412

https://www.bbc.com/turkce/haberler-dunya-56324776

https://fortune.com/2023/04/14/deepfakes-ai-state-propaganda

Yorum bırakın